[Статистика в IT] Как перейти к байесовским доверительным интервалам, не потеряв понимание классического частотного вывода

Автор

Сообщение

news_bot ®

Стаж: 7 лет 9 месяцев

Сообщений: 27286

Много слов уже сказано о доверительных интервалах для оценки параметра в байесе и частотке. Существуют десятки объяснений, но ни одно из них не показывает "на пальцах", чем отличаются механизмы создания этих интервалов. Так вот давайте еще и я попробую объяснить вам так, чтобы вы больше никогда не конфузились при их упоминании.В частотном анализе, о чем вы наверняка слышали, есть одна проблема: мало кто понимает, как правильно интерпретировать классические частотные доверительные интервалы (confidence intervals). В связи с чем часто их путают с байесовскими (credible intervals).

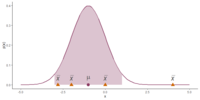

Информация ниже содержит the nuts and bolts построения обоих доверительных интервалов (которые почему-то не описываются в книгах и форумах), а также минусы использования этих методов.ЧастоткаВ учебниках по статистике пишут так: "У вас есть точечная оценка некоторого параметра. Теперь подставьте ее в формулу для доверительного интервала. Вот ваш интервал. Верьте ему с вероятностью 0.95, что бы это не значило." До обнаружения существования байесовского вывода вопросов и не возникало, да? А теперь, чтобы понять разницу в мышлении, приходится разбираться по-новой и в частотке.Предлагаю рассмотреть пример оценки неизвестного параметра абстрактного распределения. Допустим, имеем какое-то произвольное распределение с некоторой дисперсией σ2 и матожиданием μ. У μ есть конкретное значение (обозначим его на рисунке), но представим, что мы не знаем, где оно находится. Перед нами стоит задача оценить, чему же равно μ.

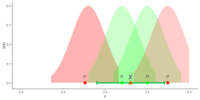

Как полагается по центральной предельной теореме, берем из генеральной совокупности выборку размера n и рассчитываем ее среднее арифметическое X̄. Если проделывать эту операцию множество раз, значения X̄ будут иметь нормальное распределение N(μ, σ2/n). Изобразим это на графике.

Теперь будем рассуждать так. Если мы получаем много разных значений X̄, то положение μ мы можем определить (потому что получим нормальное распределение по ЦПТ). Но если у нас будет только одно значение, что делать? Тогда придется выбрать интервал вокруг полученного X̄, в пределах которого должно находится истинное значение μ. Другими словами, если мы построим интервал (-2; 3), то с какой-то вероятностью ожидаем, что Бог нам скажет "О да, настоящее μ = -1, ваш интервал содержит истинное значение". Но проблема в том, что если X̄ равно уж очень екстремальному значению, тогда какой бы широкий интервал мы не выбрали, все равно μ может оказаться за его пределами. Так что делать?Так как мы читерим и на самом деле видим, где находится наш параметр μ, давайте рассуждать с его позиции. μ хочет, чтобы как можно больше выборочных средних его включили в свой интервал. Поэтому будет требовать, чтобы хотя бы 95% X̄ давали правильный интервал. А точнее так: пусть все значения X̄, которые больше 2.5% квантиля и меньше 97.5% квантиля, дают интервалы, в которых точно содержится μ. А те, которые дальше от μ, так и быть, дают неправильные интервалы. Такое вот требование выставляет параметр μ.

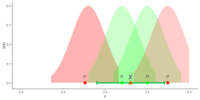

Теперь рассуждаем от лица X̄, которые мы получили эмпирически. X̄ не знает, где находится μ, но очень хочет, чтобы его интервал содержал μ. Он знает, что ему нужно попасть в нужные квантили, чтобы показывать правильный интервал. Где же тогда может находиться μ?

Начинаем перебирать все значения μ с их перцнтилями. Напомню, что 95% интервал вокруг μ равен μ ± 2 * std (в нашем примере std = σ/n^0.5, но не будем запутываться). Как видим, X̄ не попадает в некоторые перцентили(красные на рисунке), а в некоторые попадает(зеленые) - вот для этих μ наша оценка должна выдавать правильный интервал. Отсюда, границы нашего интервала формируются самыми критичными значениями μ, при которых X̄ еще содержится в μ ± 2 * std. Тогда и расстояние от X̄ до границ интервала равны 2 * std.

Теперь мы готовы сказать: имея некоторое эмпирическое наблюдение, которое взято из нормального распределения, мы можем построить доверительный интервал X̄ ± 2 * std.

5% интервалов не содержат истинное значение неизвестного параметраНаконец, можем сделать вывод.

Доверительный интервал в частотной статистике строится индивидуально для каждого эксперимента. В 95% случаев эти интервалы содержат истинное значение оцениваемого параметра. Однако, к сожалению, в 5% случаев(в 5 из 100 экспериментов) мы указываем вовсе неправильный диапазон значений.

Собственно, этот факт и дизморалит. Обычно задача стоит провести только 1 эксперимент и дать какую-то оценку неизвестному параметру. Этот 1 опыт может оказаться в тех самых 5% и мы дадим просто безсмысленную оценку параметру. БайесКак ни странно, Байес оказывается более интуитивным в интерпретации доверительных интервалов.

Байесовский доверительный интервал - такой, который содежит значение неизвестного параметра с вероятностью 95%. То есть мы так же получаем разные выборочные данные X̄, но теперь по ним строим единственный интервал. Получая новые данные, мы можем апдейтить модель, тем самым сужая диапазон значений, в которых почти точно находится наш параметр. Таким образом, ключевое отличие credible interval от confident interval в том, что мы имеем дело не просто с фиксированным (хоть и неизвестным) значением параметра, а с целым распределением его предполагаемых значений. Однако такой подход накладывает дополнительные условия. Нужно выбирать априорное распределение неизвестного параметра. Оно информативно, если мы заранее можем предположить, где находятся более вероятные значения, или же неинформативно(можем взять даже равномерное распределение, если не беремся ничего предполагать).

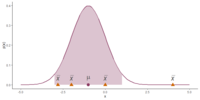

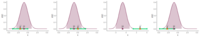

Переходим к конкретике. Допустим, мы думаем, что параметр μ ~ N(0, 6). Как видите на рисунке ниже, это довольно слабое априорное распределение. Далее мы получаем первое наблюдение X̄ и для каждого возможного значения μ строим функцию правдоподобия. Функция правдоподобия определяет, насколько возможно получить именно такую оценку X̄, если бы она была взята из распределения с таким-то или таким-то параметром μ. У нас это распределение N(μ, σ2/n) (по ЦГТ, как обсуждалось ранее).

Например, очень вероятно значение μ2 считается очень вероятным, однако если бы оно было истинным, то мы бы маловероятно получили X̄ (потому что они находится достаточно далеко друг от друга). Чтобы уравновесить эти выводы для всех возможных значений μ, мы перемножаем по теореме Байеса likelihood и priors. Таким образом, получили апостериорную оценку вероятности, что μ = μ2. Проделываем это с каждым вероятным значением μ.

оТеперь, имея апостериорное распределение параметра μ, мы выделяем самый маленький интервал, в котором содержится 95% вероятностных значений параметра (HPDI) и называем его доверительным. Вуаля.

Сок байесовского подхода в том, что если мы получаем несколько значений X̄, мы можем апдейтить наш интервал, подкрепляя его эмпирическими данными. А проблема тут в том, что если истинное значение будет экстремальным, то мы нашим интервалом просто его не покроим, потому что оно маловероятно.

Итак, мы закрыли тему доверительных интервалов для непрерывных величих. Искренне надеюсь, что эти умозаключения безошибочны, однако открыта к любой критике.Если вас интересуют также интервалы для дискретных значений, рекомендую внимательно прочитать пример с печеньем, описанный в ответе на форуме StackExchange.

===========

Источник:

habr.com

===========

Похожие новости:

- [Поисковые технологии, Законодательство в IT, Статистика в IT, Копирайт] Роскомсвобода: в России в 2020 году заблокировали более 190 тысяч интернет-ресурсов

- [Карьера в IT-индустрии, Статистика в IT, IT-компании] Как пройти собеседование в FAANG: статистика

- [Информационная безопасность, Поисковые технологии, Статистика в IT] Поисковик DuckDuckGo установил дневной рекорд в 100 млн запросов

- [Python] Поиск известных паттернов на Forex с Python

- [Статистика в IT, Игры и игровые приставки] Valve: в 2020 году геймеры провели за играми в полтора раза больше времени

- [.NET, Разработка игр, Unity, CGI (графика), AR и VR] Поговорим про градиенты в Unity

- [Алгоритмы, Математика, Машинное обучение, Искусственный интеллект] Алгоритм обучения нейронных сетей с помощью нового вида чисел

- [Медгаджеты, Здоровье] Razer представила маску N95 со светодиодной подсветкой и проекцией голоса

- [Исследования и прогнозы в IT, Статистика в IT] В России интернетом не пользуются только 2,9% молодых людей

- [Статистика в IT, Финансы в IT] Мировой рынок ПК за 2020 год вырос более чем на 10% — впервые так масштабно за десять лет

Теги для поиска: #_statistika_v_it (Статистика в IT), #_doveritelnyj_interval (доверительный интервал), #_verojatnost (вероятность), #_bajes (байес), #_chastotnyj_analiz (частотный анализ), #_95%, #_raspredelenie_verojatnosti (распределение вероятности), #_bajesovskij_podhod (байесовский подход), #_plotnost_verojatnosti (плотность вероятности), #_statistika (статистика), #_matematika (математика), #_statistika_v_it (

Статистика в IT

)

Вы не можете начинать темы

Вы не можете отвечать на сообщения

Вы не можете редактировать свои сообщения

Вы не можете удалять свои сообщения

Вы не можете голосовать в опросах

Вы не можете прикреплять файлы к сообщениям

Вы не можете скачивать файлы

Текущее время: 29-Ноя 23:03

Часовой пояс: UTC + 5

| Автор | Сообщение |

|---|---|

|

news_bot ®

Стаж: 7 лет 9 месяцев |

|

|

Много слов уже сказано о доверительных интервалах для оценки параметра в байесе и частотке. Существуют десятки объяснений, но ни одно из них не показывает "на пальцах", чем отличаются механизмы создания этих интервалов. Так вот давайте еще и я попробую объяснить вам так, чтобы вы больше никогда не конфузились при их упоминании.В частотном анализе, о чем вы наверняка слышали, есть одна проблема: мало кто понимает, как правильно интерпретировать классические частотные доверительные интервалы (confidence intervals). В связи с чем часто их путают с байесовскими (credible intervals). Информация ниже содержит the nuts and bolts построения обоих доверительных интервалов (которые почему-то не описываются в книгах и форумах), а также минусы использования этих методов.ЧастоткаВ учебниках по статистике пишут так: "У вас есть точечная оценка некоторого параметра. Теперь подставьте ее в формулу для доверительного интервала. Вот ваш интервал. Верьте ему с вероятностью 0.95, что бы это не значило." До обнаружения существования байесовского вывода вопросов и не возникало, да? А теперь, чтобы понять разницу в мышлении, приходится разбираться по-новой и в частотке.Предлагаю рассмотреть пример оценки неизвестного параметра абстрактного распределения. Допустим, имеем какое-то произвольное распределение с некоторой дисперсией σ2 и матожиданием μ. У μ есть конкретное значение (обозначим его на рисунке), но представим, что мы не знаем, где оно находится. Перед нами стоит задача оценить, чему же равно μ. Как полагается по центральной предельной теореме, берем из генеральной совокупности выборку размера n и рассчитываем ее среднее арифметическое X̄. Если проделывать эту операцию множество раз, значения X̄ будут иметь нормальное распределение N(μ, σ2/n). Изобразим это на графике.  Теперь будем рассуждать так. Если мы получаем много разных значений X̄, то положение μ мы можем определить (потому что получим нормальное распределение по ЦПТ). Но если у нас будет только одно значение, что делать? Тогда придется выбрать интервал вокруг полученного X̄, в пределах которого должно находится истинное значение μ. Другими словами, если мы построим интервал (-2; 3), то с какой-то вероятностью ожидаем, что Бог нам скажет "О да, настоящее μ = -1, ваш интервал содержит истинное значение". Но проблема в том, что если X̄ равно уж очень екстремальному значению, тогда какой бы широкий интервал мы не выбрали, все равно μ может оказаться за его пределами. Так что делать?Так как мы читерим и на самом деле видим, где находится наш параметр μ, давайте рассуждать с его позиции. μ хочет, чтобы как можно больше выборочных средних его включили в свой интервал. Поэтому будет требовать, чтобы хотя бы 95% X̄ давали правильный интервал. А точнее так: пусть все значения X̄, которые больше 2.5% квантиля и меньше 97.5% квантиля, дают интервалы, в которых точно содержится μ. А те, которые дальше от μ, так и быть, дают неправильные интервалы. Такое вот требование выставляет параметр μ. Теперь рассуждаем от лица X̄, которые мы получили эмпирически. X̄ не знает, где находится μ, но очень хочет, чтобы его интервал содержал μ. Он знает, что ему нужно попасть в нужные квантили, чтобы показывать правильный интервал. Где же тогда может находиться μ?  Начинаем перебирать все значения μ с их перцнтилями. Напомню, что 95% интервал вокруг μ равен μ ± 2 * std (в нашем примере std = σ/n^0.5, но не будем запутываться). Как видим, X̄ не попадает в некоторые перцентили(красные на рисунке), а в некоторые попадает(зеленые) - вот для этих μ наша оценка должна выдавать правильный интервал. Отсюда, границы нашего интервала формируются самыми критичными значениями μ, при которых X̄ еще содержится в μ ± 2 * std. Тогда и расстояние от X̄ до границ интервала равны 2 * std. Теперь мы готовы сказать: имея некоторое эмпирическое наблюдение, которое взято из нормального распределения, мы можем построить доверительный интервал X̄ ± 2 * std.  5% интервалов не содержат истинное значение неизвестного параметраНаконец, можем сделать вывод. Доверительный интервал в частотной статистике строится индивидуально для каждого эксперимента. В 95% случаев эти интервалы содержат истинное значение оцениваемого параметра. Однако, к сожалению, в 5% случаев(в 5 из 100 экспериментов) мы указываем вовсе неправильный диапазон значений. Собственно, этот факт и дизморалит. Обычно задача стоит провести только 1 эксперимент и дать какую-то оценку неизвестному параметру. Этот 1 опыт может оказаться в тех самых 5% и мы дадим просто безсмысленную оценку параметру. БайесКак ни странно, Байес оказывается более интуитивным в интерпретации доверительных интервалов. Байесовский доверительный интервал - такой, который содежит значение неизвестного параметра с вероятностью 95%. То есть мы так же получаем разные выборочные данные X̄, но теперь по ним строим единственный интервал. Получая новые данные, мы можем апдейтить модель, тем самым сужая диапазон значений, в которых почти точно находится наш параметр. Таким образом, ключевое отличие credible interval от confident interval в том, что мы имеем дело не просто с фиксированным (хоть и неизвестным) значением параметра, а с целым распределением его предполагаемых значений. Однако такой подход накладывает дополнительные условия. Нужно выбирать априорное распределение неизвестного параметра. Оно информативно, если мы заранее можем предположить, где находятся более вероятные значения, или же неинформативно(можем взять даже равномерное распределение, если не беремся ничего предполагать). Переходим к конкретике. Допустим, мы думаем, что параметр μ ~ N(0, 6). Как видите на рисунке ниже, это довольно слабое априорное распределение. Далее мы получаем первое наблюдение X̄ и для каждого возможного значения μ строим функцию правдоподобия. Функция правдоподобия определяет, насколько возможно получить именно такую оценку X̄, если бы она была взята из распределения с таким-то или таким-то параметром μ. У нас это распределение N(μ, σ2/n) (по ЦГТ, как обсуждалось ранее). Например, очень вероятно значение μ2 считается очень вероятным, однако если бы оно было истинным, то мы бы маловероятно получили X̄ (потому что они находится достаточно далеко друг от друга). Чтобы уравновесить эти выводы для всех возможных значений μ, мы перемножаем по теореме Байеса likelihood и priors. Таким образом, получили апостериорную оценку вероятности, что μ = μ2. Проделываем это с каждым вероятным значением μ.  оТеперь, имея апостериорное распределение параметра μ, мы выделяем самый маленький интервал, в котором содержится 95% вероятностных значений параметра (HPDI) и называем его доверительным. Вуаля.  Сок байесовского подхода в том, что если мы получаем несколько значений X̄, мы можем апдейтить наш интервал, подкрепляя его эмпирическими данными. А проблема тут в том, что если истинное значение будет экстремальным, то мы нашим интервалом просто его не покроим, потому что оно маловероятно. Итак, мы закрыли тему доверительных интервалов для непрерывных величих. Искренне надеюсь, что эти умозаключения безошибочны, однако открыта к любой критике.Если вас интересуют также интервалы для дискретных значений, рекомендую внимательно прочитать пример с печеньем, описанный в ответе на форуме StackExchange. =========== Источник: habr.com =========== Похожие новости:

Статистика в IT ) |

|

Вы не можете начинать темы

Вы не можете отвечать на сообщения

Вы не можете редактировать свои сообщения

Вы не можете удалять свои сообщения

Вы не можете голосовать в опросах

Вы не можете прикреплять файлы к сообщениям

Вы не можете скачивать файлы

Вы не можете отвечать на сообщения

Вы не можете редактировать свои сообщения

Вы не можете удалять свои сообщения

Вы не можете голосовать в опросах

Вы не можете прикреплять файлы к сообщениям

Вы не можете скачивать файлы

Текущее время: 29-Ноя 23:03

Часовой пояс: UTC + 5